ChatGPT使ってますか?

今年よりChatGPTがメディアを賑やかにしてきました。

注目されるや否や、国が動きだし、各自治体でも積極的に活用していく動きがあります。その動きは、これまでのIT革新を取り戻すかのように、そしてこれまでに無かった素早い動きに非常に驚かされます。

ChatGPTは介護分野で使える?

私は使えると思っています。例えば、ご利用者やご家族向けの文書作成については打ち込むより早いです。コピーして貼り付けして、あとは全体の体裁を整えて、少しだけ事業所仕様に変更すれば完成します。

ちなみに筆者は、こういった使い方はしたことがありません。条件を打ち込んで文章をAIに作ってもらうより、自分で打つ方が早いからです。それだけ文書を打つ経験数が多いからともいえますが…事実として、そのような感じです。

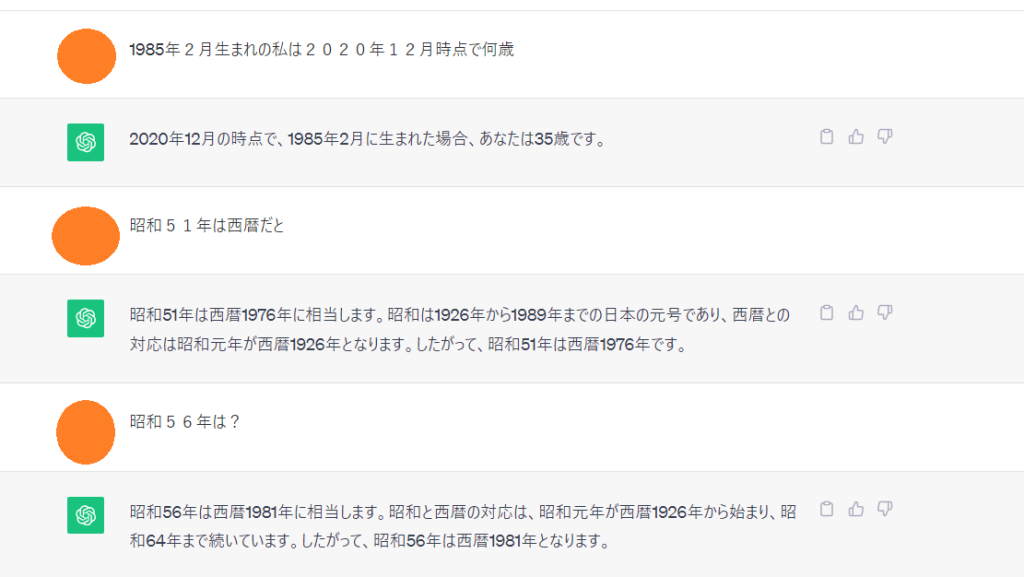

筆者が最近一番使うのは、昭和を西暦に直す時に使ってます。例えば、健康診断の手続き等で、スタッフの生年月日を西暦に打ち直さなければならない時など…

このような感じで最近は、西暦と和暦の返還に使っています

ChatGPTは、その時のやり取りごとに保存されているので、その際のやり取りを引っ張り出せば「昭和〇〇年は?」と聞くだけで西暦を教えてくれます。実務経験年数を算出する時にも使えるのではないかと思います。

そう考えると、介護技術に関することより管理運営のフォローに特化しているといえそうです。時間がない中で、これはとても助かりますね。

ChatGPTは相談ごとにも乗ってくれる

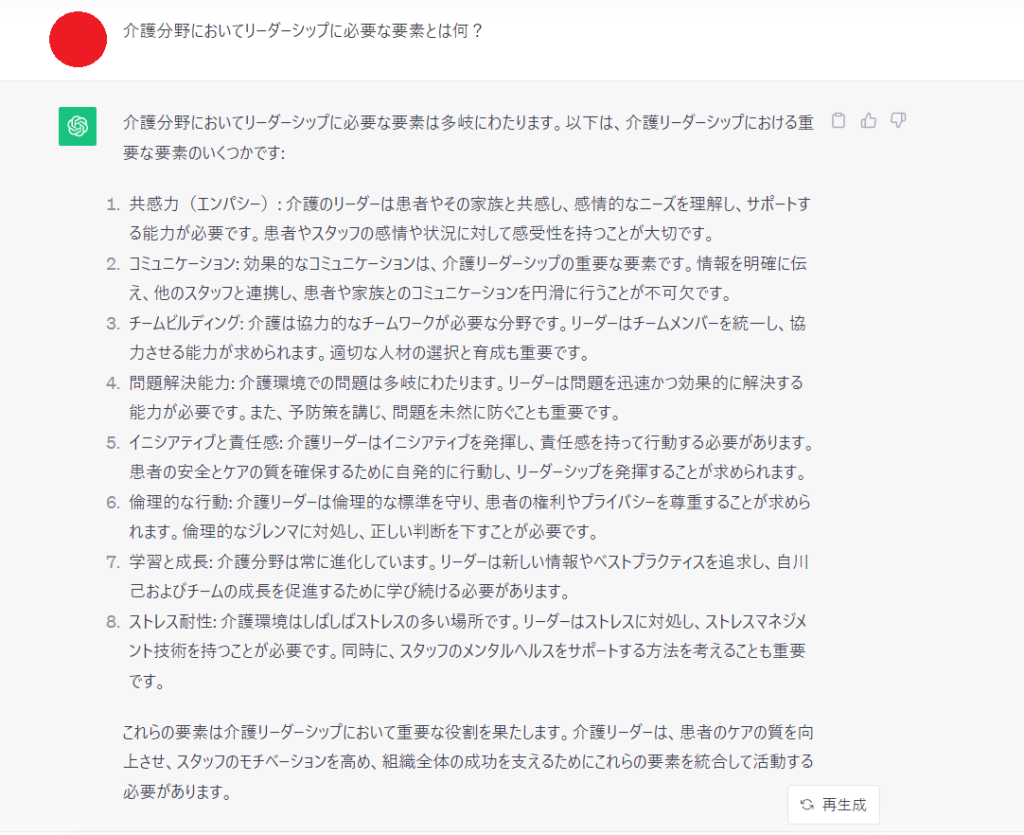

会話型AIなので、例えば新しい仕組みを考える時に考えを整理したり、また必要な資料作成にも使えます。

例えば、リーダーシップに関する研修を企画しようとした時に「介護分野においてリーダーシップに必要な要素とは何?」と聞けば、「共感力」や「学習と成長」など、8つ程度の項目を解説付きで教えてくれます。その中で、特に学んでもらいたいものに絞ってAIと対話を続ければ、学習目的を達成するための手法がより細かく作れるようになったりもします。

介護分野に絞って聞いてみた内容。AIは過去の膨大なデータを収集、抽出して回答しています

ChatGPT利用の際に気を付けるべきこと

ChatGPTでアメリカの弁護士2名が裁判所に提出する資料を作成して提出した際に、その資料の中にあった8件中6件の判例が実際は存在しない判例として問題になった。結果として、この2名は5000ドル(2023年10月現在で約75万円)の制裁金を支払うということになりました。

このように、ChatGPTが嘘の情報をあたかも本当にあるかのように話すことは、時々ニュースでも話題になります。

こんな時、筆者は25年前を思い出します。当時は光回線が出てきたばかりの時代で、ようやく一般にネットが普及してきた頃でした。この頃、ネットをよく利用するものの間で知られていたことは、ネットの情報は3割が事実で7割が嘘というものです。当時はレポートをネットの資料から出しても、講師からは受け取ってもらえないということもありました。

重要なのは、その資料の出どころがどこかということで、特に当時は名誉ある団体が出しているA級資料なのか、それともそれに関係する何某か出しているB級資料なのか、はたまた伝聞系のホントにあるかどうかも分からないようなC級資料なのかと、しっかり精査した上で出すようにしていました。

今では、学会のレポートや文献等もネットで簡単に引っ張り出せるようになったこともあり、大分嘘をつかまされるハードルは低くなったと感じています。

さて、話を戻しましてChatGPTも現在同じような立ち位置なのだと考えます。今後は益々ルール整備やAI自体のバージョンアップにより活用は増えていくことは間違いないでしょう。これが当たり前になってくる可能性も十分に考えられます。

今この時、これを嫌って使わないまま時が過ぎて、いよいよ使えなくなるのか。それともちょっとでも扱ってみて、その使い方に馴染んでおくのか。

案外、この選択が将来的な自分自身の能力に影響してくる、そんな気もしていて挑戦しています。